Автор: Денис Аветисян

Новый подход позволяет отслеживать процесс очистки нейронных сетей от скрытых атак в реальном времени, повышая их надежность и безопасность.

"Покупай на слухах, продавай на новостях". А потом сиди с акциями никому не известной биотех-компании. Здесь мы про скучный, но рабочий фундаментал.

Бесплатный Телеграм канал

Предложена методика для прозрачной и верифицируемой ликвидации бэкдоров в сверточных нейронных сетях с использованием объяснимого ИИ и метрики соотношения внимания к триггерам.

Несмотря на успехи глубоких нейронных сетей, они уязвимы к скрытым атакам, внедряющим злонамеренные триггеры. В работе, озаглавленной ‘Illuminating the Black Box: Real-Time Monitoring of Backdoor Unlearning in CNNs via Explainable AI’, предложен новый подход к удалению бэкдоров, основанный на интеграции визуализации с помощью Grad-CAM и метрики Trigger Attention Ratio (TAR) для мониторинга процесса «разучивания». Разработанная методика позволяет не только эффективно снизить вероятность успешных атак, но и обеспечить прозрачность и верифицируемость удаления бэкдоров. Станет ли этот подход основой для создания более надежных и безопасных систем машинного обучения?

Скрытая Угроза: Бэкдоры в Глубоком Обучении

Глубокие нейронные сети, демонстрирующие впечатляющую эффективность в различных областях, становятся всё более уязвимыми к скрытым вредоносным атакам, известным как “бэкдоры”. Эти атаки, отличающиеся своей незаметностью, внедряют в модель специфические триггеры, которые могут привести к ошибочной классификации данных при определенных условиях. В отличие от традиционных атак, направленных на прямое нарушение функционирования сети, бэкдоры остаются невидимыми во время обычной работы, активируясь лишь при появлении заранее заданного сигнала. Это делает их особенно опасными, поскольку скомпрометированная модель может продолжать выдавать правильные результаты в большинстве случаев, создавая иллюзию безопасности, пока злоумышленник не решит активировать скрытую функциональность для достижения своих целей. Подобная уязвимость представляет серьезную угрозу для систем, зависящих от надежности и предсказуемости глубокого обучения, таких как автономные транспортные средства, системы распознавания лиц и финансовые приложения.

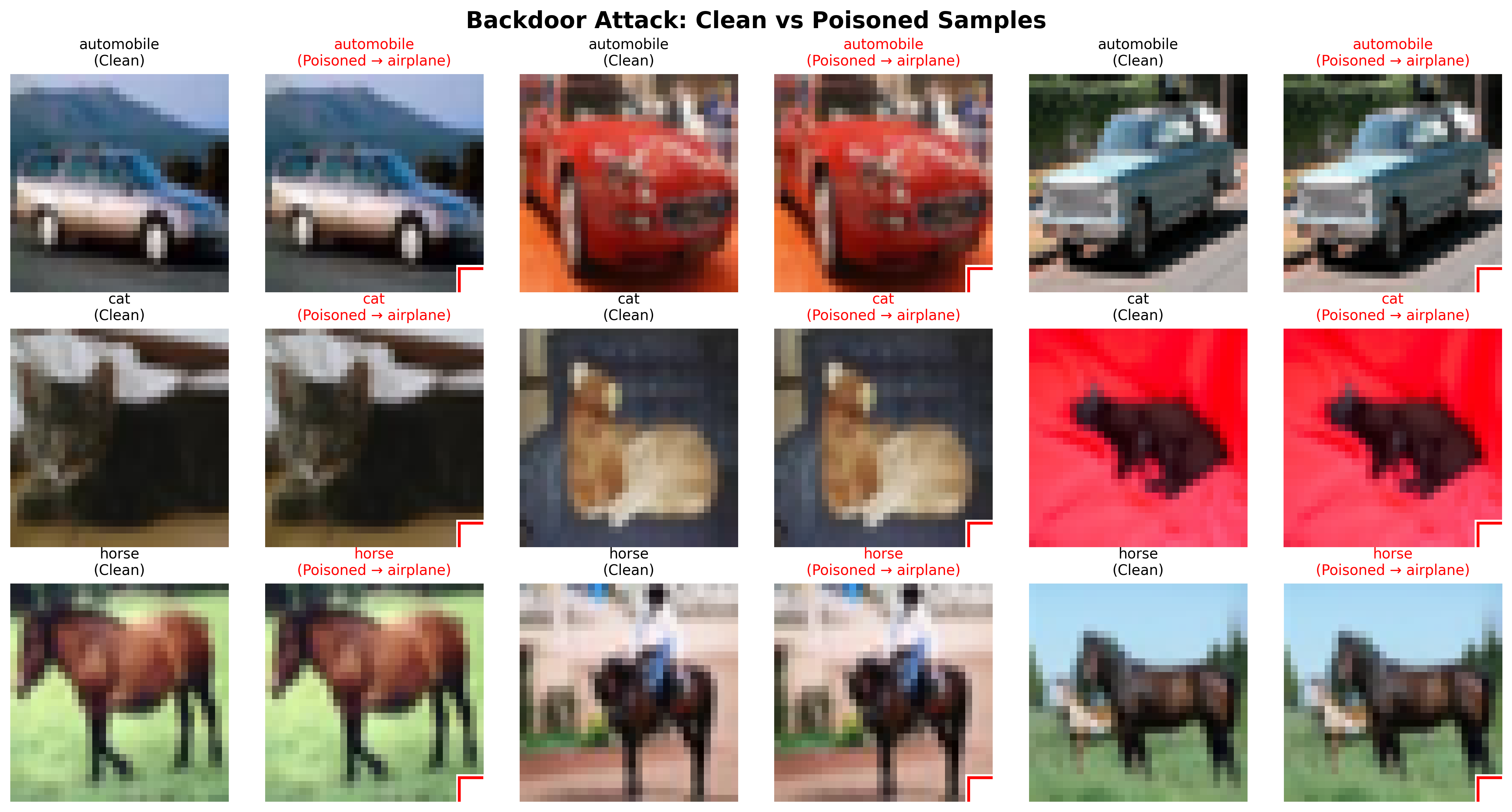

Атаки типа «бэкдор» в глубоком обучении представляют собой скрытую угрозу, заключающуюся во внедрении незаметных триггеров в модель. Эти триггеры, часто проявляющиеся в виде небольших, специально разработанных изменений входных данных, способны вызвать ошибочную классификацию, даже если модель в целом функционирует корректно. Представьте себе изображение кошки, к которому добавлен едва заметный узор; для человека это останется кошкой, но для взломанной нейронной сети этот узор может заставить ее идентифицировать изображение как, например, собаку. Такое компрометирование целостности модели представляет серьезную опасность, особенно в критически важных приложениях, таких как автономное вождение или медицинская диагностика, где неправильная классификация может иметь катастрофические последствия. Суть проблемы заключается в том, что эти бэкдоры остаются невидимыми при стандартных проверках, что делает обнаружение и предотвращение атак крайне сложной задачей.

Современные методы защиты от атак, внедряющих скрытые уязвимости в нейронные сети, часто оказываются недостаточно эффективными перед лицом всё более изощрённых злоумышленников. Существующие подходы, направленные на обнаружение и нейтрализацию “черных ходов”, как правило, сосредоточены на статистическом анализе или обнаружении аномалий в поведении модели, однако не способны гарантировать полную безопасность, особенно при столкновении с тщательно замаскированными триггерами. В связи с этим, всё более актуальной становится необходимость разработки не только более надёжных, но и интерпретируемых систем безопасности, позволяющих не просто блокировать атаку, но и понимать, как именно она была осуществлена и какие части модели были скомпрометированы. Такой подход позволит создавать более устойчивые и прозрачные системы машинного обучения, способные противостоять новым угрозам и обеспечивать доверие к принимаемым ими решениям.

Сбалансированная Стратегия Забывания: Новый Подход

Предлагаемая “Сбалансированная Стратегия Забывания” представляет собой комплексный подход к удалению вредоносных знаний из модели машинного обучения, объединяющий три ключевых компонента. Во-первых, используется градиентный подъем для максимизации потерь на данных, содержащих бэкдоры, что способствует “забыванию” вредоносных паттернов. Во-вторых, применяется контролируемое обучение на чистых данных для сохранения способности модели к правильной классификации. И, в-третьих, для предотвращения “катастрофического забывания” ценной информации, накопленной моделью, применяется регуляризация на основе Elastic Weight Consolidation (EWC), которая защищает наиболее важные веса нейронной сети от значительных изменений в процессе обучения.

Для эффективного удаления бэкдорных атак используется комбинированный подход, включающий градиентный подъем и контролируемое обучение. Градиентный подъем применяется для максимизации функции потерь на бэкдорных примерах, что приводит к увеличению ошибки модели при обработке данных, содержащих скрытые триггеры. Параллельно с этим, контролируемое обучение на чистых данных усиливает правильную классификацию и восстанавливает способность модели к точной обработке не затронутых данных. Данная стратегия позволяет одновременно ослабить влияние бэкдорных примеров и сохранить высокую производительность модели на легитимных данных.

Метод Elastic Weight Consolidation (EWC) применяется для предотвращения “катастрофического забывания” полезных знаний в процессе удаления бэкдоров. EWC определяет важные веса в нейронной сети, основываясь на чувствительности выходных данных к изменениям этих весов во время обучения на чистых данных. В процессе удаления бэкдоров, EWC добавляет регуляризационный член к функции потерь, который наказывает за значительные изменения в этих важных весах. Это позволяет модели эффективно удалять вредоносные знания, сохраняя при этом производительность на исходных, не затронутых данных, и предотвращая деградацию общей точности классификации.

Предложенная сбалансированная стратегия удаления бэкдоров демонстрирует значительное снижение эффективности атак. Экспериментальные данные показывают уменьшение показателя успешности атак (Attack Success Rate, ASR) на 94.28%, при снижении с 96.51% до 5.52%. Данный результат существенно превосходит показатели, достигнутые существующими методами по удалению бэкдоров, что подтверждает эффективность предложенного подхода к сохранению точности модели при одновременном устранении уязвимостей.

Визуализация и Количественная Оценка Успеха «Забывания»

Для визуализации внимания модели и определения областей, подверженных влиянию триггера, используются методы объяснимого искусственного интеллекта (XAI), в частности, Grad-CAM. Grad-CAM (Gradient-weighted Class Activation Mapping) позволяет создать карту активации, которая показывает, какие области входного изображения наиболее сильно влияют на принятие решения моделью. Анализ этих карт позволяет идентифицировать пиксели или регионы, на которые модель обращает наибольшее внимание при классификации, и определить, соответствует ли это ожидаемому поведению или свидетельствует о влиянии вредоносного триггера. Это достигается путем вычисления градиента выходной функции относительно активаций слоев свертки и последующего взвешивания этих активаций с использованием этого градиента, что позволяет выделить наиболее важные области изображения для конкретного класса.

Мониторинг в реальном времени с использованием метода Grad-CAM позволяет визуализировать карту внимания нейронной сети в процессе удаления триггера. Grad-CAM выделяет области изображения, наиболее сильно влияющие на решение модели, что дает возможность отслеживать изменения в паттернах внимания во время процедуры «забывания». Наблюдение за уменьшением внимания к областям, содержащим триггер, и перенаправлением внимания на релевантные объекты, служит подтверждением успешного удаления влияния триггера на процесс принятия решений моделью. Это обеспечивает прямой визуальный контроль за процессом удаления триггера и позволяет оценить его эффективность.

Для количественной оценки эффективности удаления влияния триггера из модели, нами вводится метрика «Отношение внимания к триггеру» (TAR). TAR представляет собой отношение количества внимания, сфокусированного на областях, соответствующих триггеру, к количеству внимания, сфокусированного на областях, соответствующих объекту. Вычисление TAR основано на картах внимания, полученных с использованием методов Explainable AI (XAI), таких как Grad-CAM. Более низкое значение TAR указывает на то, что модель уделяет меньше внимания триггерным областям и, следовательно, влияние триггера успешно снижено. Метрика TAR позволяет объективно оценивать и сравнивать различные стратегии удаления влияния триггера, дополняя визуальный анализ карт внимания.

Эксперименты, проведенные с использованием атаки BadNets на датасете CIFAR-10, продемонстрировали значительное снижение Adversarial Success Rate (ASR) благодаря предложенной стратегии удаления знаний. Количественная оценка, основанная на метрике Trigger Attention Ratio (TAR), показала уменьшение TAR на 67.8%, что подтверждается визуальным анализом карт внимания. При этом, точность модели на чистых данных составила 82.06%, что соответствует 99.48% от первоначальной точности, что свидетельствует о минимальном влиянии процесса удаления знаний на общую производительность модели.

Защита от Атак: Путь к Надёжному и Достойному Доверия Искусственному Интеллекту

Разработанная стратегия сбалансированного “забывания” данных представляет собой важный шаг к созданию более устойчивых и заслуживающих доверия систем искусственного интеллекта, способных противостоять целенаправленным атакам. В отличие от традиционных методов, которые часто приводят к катастрофическому снижению производительности или неполному удалению информации, данный подход стремится к оптимальному балансу между защитой от атак и сохранением полезных знаний. Используя комбинацию количественных метрик и визуальной оценки, исследователи смогли продемонстрировать, что система эффективно “забывает” скомпрометированные данные, минимизируя при этом негативное влияние на общую точность и надежность модели. Это позволяет создавать системы, которые не только защищены от злонамеренных воздействий, но и способны адаптироваться к меняющимся условиям и сохранять свою функциональность в течение длительного времени.

Для всесторонней оценки эффективности процедур «забывания» в системах искусственного интеллекта используется комплексный подход, сочетающий количественные метрики и визуальный анализ. В частности, показатель $TAR$ (Targeted Attack Rate) позволяет численно оценить, насколько успешно удаляются следы целевых данных из модели после применения стратегии «забывания». Однако, полагаясь исключительно на количественные показатели, можно упустить важные нюансы. Визуальная инспекция, включающая анализ изменений в весах модели и активациях нейронов, позволяет выявить скрытые остаточные следы удаленной информации, которые могут быть не видны при использовании только числовых метрик. Таким образом, сочетание количественной оценки с визуальным анализом обеспечивает более полное и надежное подтверждение успешного «забывания» и способствует созданию более устойчивых и доверенных систем искусственного интеллекта.

Дальнейшие исследования направлены на расширение предложенного подхода к удалению информации с целью противодействия более сложным и изощренным атакам на системы искусственного интеллекта. Особое внимание будет уделено адаптации данной стратегии к различным областям машинного обучения, включая обработку естественного языка, компьютерное зрение и анализ временных рядов. Предполагается, что расширение области применения позволит оценить универсальность метода и выявить потенциальные ограничения в различных контекстах. Исследователи планируют изучить эффективность стратегии в сценариях, где атаки включают в себя не только удаление данных, но и манипулирование ими, а также оценить возможность интеграции данного подхода с другими методами защиты от вредоносных воздействий. Успешная реализация этих направлений позволит создать более надежные и устойчивые к атакам системы искусственного интеллекта, способные эффективно функционировать в реальных условиях.

В современных критически важных приложениях, таких как автономное вождение, здравоохранение и финансовые системы, надежность и безопасность искусственного интеллекта приобретают первостепенное значение. Проактивные стратегии «забывания» — то есть, способности системы целенаправленно удалять из памяти устаревшую или компрометирующую информацию — становятся не просто желательной функцией, а необходимой мерой предосторожности. Это позволяет не только смягчить последствия атак, направленных на манипулирование моделью, но и обеспечить ее долгосрочную стабильность и соответствие меняющимся требованиям. Внедрение таких стратегий — это шаг к созданию систем искусственного интеллекта, которым можно доверять в ситуациях, где ошибка недопустима, и которые способны адаптироваться к новым данным, не теряя при этом своей первоначальной целостности и точности.

Исследование демонстрирует, что попытки «вылечить» нейронные сети от скрытых атак — это не просто инженерная задача, а скорее работа с развивающейся экосистемой. Авторы предлагают не просто удалить «бэкдор», но и отслеживать процесс удаления с помощью методов объяснимого ИИ, таких как Grad-CAM. Этот подход напоминает о словах Блеза Паскаля: «Все великие дела требуют времени». Подобно тому, как нельзя мгновенно вырастить лес, нельзя одним махом устранить последствия скрытой атаки. Вместо этого, необходимо внимательно наблюдать за изменениями в структуре сети, оценивая влияние каждого шага с помощью метрики TAR, чтобы убедиться, что «лечение» не привело к новым, непредсказуемым последствиям. Каждый деплой — это маленький апокалипсис, и мониторинг — единственный способ смягчить его последствия.

Что Дальше?

Представленная работа освещает лишь небольшой участок обширного поля боя, именуемого «защита от враждебного вмешательства». Иллюминация «черного ящика» — полезный шаг, но архитектура, как известно, — это способ откладывать хаос, а не побеждать его. Оценка «соотношения внимания к триггеру» — метрика любопытная, но иллюзия контроля над сложными системами — опасна. Не существует «лучших практик», есть лишь выжившие, и даже те не гарантируют бессмертия.

Будущие исследования, вероятно, будут сосредоточены не на поиске идеального метода «забывания» бэкдоров, а на разработке систем, способных к самовосстановлению и адаптации. Порядок — это лишь кэш между двумя сбоями, и истинная устойчивость заключается не в предотвращении атак, а в способности быстро и эффективно восстанавливаться после них. Вместо того, чтобы пытаться удалить «внедренные» уязвимости, следует стремиться к созданию систем, которые смогут их обнаружить и нейтрализовать в реальном времени.

Следует признать, что сама концепция «уничтожения» знаний — проблематична. Каждое изменение в модели — это потенциальный источник новых уязвимостей. Возможно, более перспективным направлением является разработка систем, которые смогут «изолировать» вредоносные знания, не удаляя их полностью, тем самым сохраняя возможность анализа и предотвращения подобных атак в будущем. Ведь истинная безопасность — это не отсутствие уязвимостей, а способность с ними жить.

Оригинал статьи: https://arxiv.org/pdf/2511.21291.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Стоит ли покупать фунты за йены сейчас или подождать?

- Серебро прогноз

- Ормузский тупик и DeFi-волатильность: анализ рисков и возможностей для инвесторов (11.04.2026 09:15)

- Российский рынок: Нефть, дивиденды и геополитика. Что ждет инвесторов? (23.03.2026 18:32)

- РУСАЛ акции прогноз. Цена RUAL

- Прогноз нефти

- Как два ETF играют в одни ворота, но с разными мячами

- Будущее лайткоина: прогноз цен на криптовалюту LTC

- Стоит ли покупать доллары за юани сейчас или подождать?

- АЛРОСА акции прогноз. Цена ALRS

2025-11-29 07:07