Автор: Денис Аветисян

Исследование показывает, что спайковые нейронные сети обеспечивают более надежную защиту от атак, направленных на восстановление обучающих данных, чем традиционные искусственные нейросети.

"Покупай на слухах, продавай на новостях". А потом сиди с акциями никому не известной биотех-компании. Здесь мы про скучный, но рабочий фундаментал.

Бесплатный Телеграм канал

Спайковые нейронные сети демонстрируют повышенную устойчивость к атакам инверсии градиента в сценариях федеративного обучения благодаря дискретности и временной динамике обработки данных.

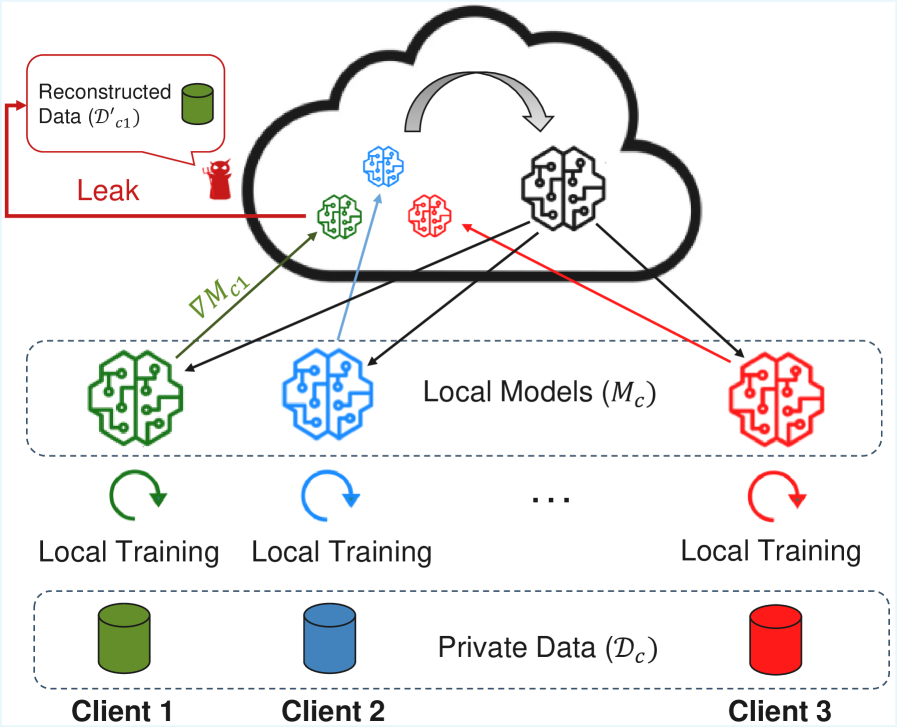

Несмотря на растущую популярность федеративного обучения для сохранения конфиденциальности данных, уязвимость к атакам инверсии градиента остается серьезной проблемой. В работе ‘Privacy in Federated Learning with Spiking Neural Networks’ исследуется, как импульсные нейронные сети (SNN) справляются с этой угрозой в условиях распределенного обучения. Полученные результаты показывают, что SNN, в отличие от традиционных искусственных нейронных сетей, демонстрируют значительно более высокую устойчивость к реконструкции обучающих данных из общих градиентов благодаря своей дискретной и временной динамике. Может ли сочетание энергоэффективности и повышенной приватности сделать SNN перспективной платформой для безопасного машинного обучения на периферийных устройствах?

Растущая Угроза: Реконструкция Данных по Градиентам

Современные методы машинного обучения всё чаще используют распределённые вычисления, где отдельные участники совместно тренируют модель, обмениваясь лишь обновлениями её параметров — градиентами. Этот подход, обеспечивающий масштабируемость и ускорение обучения, одновременно создает новые риски для конфиденциальности данных. Вместо передачи самих обучающих данных, происходит обмен информацией о том, как модель изменяется в ответ на эти данные. Несмотря на то, что градиенты предназначены для улучшения модели, они несут в себе косвенную информацию о первоначальном наборе данных, что делает возможным восстановление или вывод конфиденциальных деталей о данных, использованных для обучения. Таким образом, распространение градиентов, хоть и необходимо для коллективной работы над моделями, открывает потенциальную уязвимость, требующую разработки эффективных механизмов защиты приватности.

В современных системах машинного обучения, где модели тренируются совместно, обмен информацией об изменениях параметров — градиентами — создает уязвимость для утечки конфиденциальных данных. Злоумышленники могут использовать эти градиенты, чтобы восстановить детали исходного набора данных, на котором обучалась модель, процесс, известный как «утечка градиентов». По сути, градиенты, отражая лишь корректировки модели, неявно содержат информацию о данных, вызвавших эти корректировки, что позволяет реконструировать характеристики отдельных объектов из обучающей выборки. Это представляет серьезную угрозу для конфиденциальности, особенно в приложениях, где данные содержат личную или чувствительную информацию, например, в здравоохранении или финансах.

В основе данной уязвимости лежит тот факт, что градиенты, представляющие собой корректировки модели, одновременно несут в себе информацию о данных, которые эти корректировки вызвали. По сути, градиент — это не просто указание направления изменения параметров модели, но и отпечаток конкретных примеров, использованных при обучении. Анализируя эти градиенты, злоумышленник может восстановить частичную информацию о исходных данных, например, характеристики изображений или текстовые фрагменты, использованные для обучения модели. Этот процесс напоминает реконструкцию сигнала по его производной — чем точнее градиент, тем выше вероятность восстановления исходных данных, даже если прямая информация о них отсутствует. Таким образом, обмен градиентами, необходимый для эффективного обучения, одновременно создает канал утечки конфиденциальной информации.

Инверсия Градиента: Метод Реконструкции Данных

Атаки инверсии градиента представляют собой класс атак, направленных на восстановление конфиденциальных обучающих выборок путем анализа совместно используемых градиентов. В процессе обучения модели машинного обучения, градиенты используются для обновления параметров модели на основе данных. Атаки инверсии градиента используют эти градиенты, опубликованные или доступные злоумышленнику, для создания входных данных, которые при обучении модели дадут схожие градиенты, что позволяет восстановить информацию о исходных данных, использованных для обучения. Данный тип атаки отличается от других методов извлечения информации тем, что он напрямую использует процесс оптимизации, лежащий в основе обучения модели, для реконструкции данных.

Атаки инверсии градиента используют методы оптимизации для генерации входных данных, которые производят градиенты, схожие с теми, что наблюдались в процессе обучения модели. Этот процесс включает в себя итеративное изменение сгенерированных данных с использованием информации о градиентах, полученной от целевой модели, для минимизации разницы между градиентами сгенерированных данных и градиентами, наблюдаемыми при обучении на реальных данных. По сути, атакующий пытается «обратить» процесс обучения, восстанавливая исходные данные, которые привели к определенным градиентам, тем самым извлекая конфиденциальную информацию из модели, не имея доступа к самим данным обучения. Для реализации используются различные алгоритмы оптимизации, такие как стохастический градиентный спуск ($SGD$) или его варианты.

Атаки инверсии градиента не ограничиваются простыми наборами данных и представляют собой значительную угрозу для различных модальностей данных. Успешные реализации демонстрируют возможность восстановления конфиденциальных обучающих примеров из изображений, аудио, текстовых данных и даже структурированных данных, таких как медицинские записи. Эффективность атак не зависит от размерности пространства признаков или сложности модели, что делает их применимыми к широкому спектру задач машинного обучения, включая компьютерное зрение, обработку естественного языка и анализ данных. Более того, атаки показывают устойчивость к некоторым защитным механизмам, таким как дифференциальная конфиденциальность, при недостаточном уровне шума.

Оценка Атаки: Наборы Данных и Производительность

Эффективность атак на основе инверсии градиента была продемонстрирована на различных наборах данных, включая широко используемый MNIST, содержащий изображения рукописных цифр. Данный набор данных служит базовым для оценки и сравнения эффективности подобных атак, благодаря своей простоте и доступности. Успешность атак на MNIST подтверждает общую уязвимость нейронных сетей к извлечению информации о входных данных через анализ градиентов, что делает его важным этапом при оценке безопасности и конфиденциальности моделей машинного обучения. Дальнейшие исследования показали, что уязвимость сохраняется и на более сложных наборах данных, что подчеркивает необходимость разработки эффективных мер защиты.

Атаки инверсии градиента успешно демонстрируют свою эффективность не только на простых наборах данных, таких как MNIST, но и на более сложных. В частности, наборы данных CIFAR-100, содержащие 100 классов изображений, и наборы данных для распознавания лиц, такие как LFW (Labeled Faces in the Wild), также подвержены этим атакам. Это указывает на широкую применимость уязвимости и необходимость разработки эффективных методов защиты, даже в случаях с более разнообразными и сложными данными, используемыми в современных системах машинного зрения.

Недавние исследования показали, что атаки инверсии градиента применимы и к данным, полученным от event-based датчиков, например, к набору данных DVS128 Gesture, что расширяет область уязвимостей. В ходе нашей работы было установлено, что Spiking Neural Networks (SNN) демонстрируют значительно более высокую устойчивость к атакам, основанным на утечке градиента, по сравнению с Artificial Neural Networks (ANN). Среднее снижение Attack Success Rate (ASR) составило примерно 49% при использовании различных наборов данных, включая MNIST, CIFAR-100 и LFW, что указывает на потенциальное преимущество SNN в обеспечении конфиденциальности данных.

На наборе данных DVS128 Gesture, после оптимизации и применения пороговой обработки, значение $l_2$ расстояния составляет приблизительно 70-85, что указывает на значительное снижение качества реконструкции изображения. При этом, успешность атаки (Attack Success Rate, ASR) не превышает 10%, что сопоставимо с результатами случайного угадывания (9% для 11 классов жестов). Данные показатели свидетельствуют о низкой эффективности атак градиентного инвертирования на этом типе данных, что может быть связано со спецификой представления информации в event-based камерах.

К Надежной Защите: Проектирование с Учетом Конфиденциальности

Угроза атак инверсии градиента, направленных на восстановление обучающих данных из модели машинного обучения, требует кардинального изменения подхода к обеспечению конфиденциальности. Вместо традиционных методов, добавляющих защиту уже после создания системы, всё большее внимание уделяется принципам защиты приватности по умолчанию — Privacy-Preserving-by-Design. Данный подход подразумевает интеграцию механизмов защиты данных на самых ранних этапах разработки, в саму архитектуру и алгоритмы обучения. Это позволяет существенно снизить риск утечки конфиденциальной информации и обеспечить более надежную защиту персональных данных пользователей, предотвращая возможность реконструкции исходных данных злоумышленниками посредством анализа градиентов модели.

Вместо того, чтобы добавлять механизмы защиты конфиденциальности уже после создания системы машинного обучения, современные подходы делают акцент на проектировании с учетом принципов конфиденциальности с самого начала. Такой подход, известный как Privacy-by-Design, позволяет создавать системы, в которых защита данных является неотъемлемой частью архитектуры, а не надстройкой. Это означает, что на этапе разработки учитываются потенциальные риски утечки информации и применяются соответствующие меры для их минимизации, например, использование техник дифференциальной приватности или безопасных многосторонних вычислений. Подобная стратегия позволяет значительно снизить вероятность успешных атак, направленных на восстановление исходных данных, и обеспечить более надежную защиту пользовательской информации.

Активные меры по защите данных, такие как дифференциальная конфиденциальность и безопасные многосторонние вычисления, способны эффективно снизить риск атак реконструкции данных и обеспечить надежную защиту личной информации. Исследования показали, что переход к архитектурам спайковых нейронных сетей (SNN) может снизить вероятность успешной атаки (Attack Success Rate, ASR) примерно на 49% по сравнению с традиционными искусственными нейронными сетями (ANN). Этот результат указывает на перспективность использования SNN в качестве эффективного инструмента для повышения уровня конфиденциальности в системах машинного обучения, представляя собой значительный шаг к созданию более безопасных и ориентированных на пользователя технологий.

Исследование демонстрирует, что сети с импульсными сигналами (Spiking Neural Networks) обладают повышенной устойчивостью к атакам, направленным на восстановление обучающих данных по общим градиентам. Это обусловлено дискретностью и временной динамикой обработки информации в этих сетях. Подобная особенность напоминает о мудрости, заключенной в словах Г.Х. Харди: «Математика — это не набор готовых ответов, а процесс поиска истины». В данном контексте, SNN представляют собой сложную экосистему, где временные характеристики и дискретные сигналы создают естественную защиту от атак, а не просто набор инструментов для предотвращения утечек данных. Устойчивость системы проявляется не в изоляции компонентов, а в их способности эффективно взаимодействовать и противостоять внешним воздействиям.

Что же дальше?

Представленная работа демонстрирует, что сети импульсных нейронов, подобно каплям дождя, оставляют менее явные следы на песке градиентного инвертирования, нежели традиционные искусственные сети. Однако, устойчивость — это не абсолютная неприкосновенность. Каждое добавление сложности — будь то временная динамика или дискретность обработки — является обещанием будущей уязвимости, которую ещё предстоит обнаружить. Система, которая сопротивляется одному типу атаки, неизбежно становится более восприимчивой к другому.

Вопрос не в том, чтобы построить непробиваемую крепость, а в том, чтобы создать экосистему, способную к самовосстановлению. Следующим шагом видится не столько в усилении защиты, сколько в изучении способов адаптации к неизбежным компрометациям. Каждая зависимость от централизованного обучения — это невидимая нить, связывающая узлы федеративной сети. И когда-нибудь эта нить оборвется, заставив систему искать новые пути.

Контроль над данными — иллюзия, требующая соглашения об уровне обслуживания. Попытки удержать информацию подобны попыткам удержать воду в ладонях. Более продуктивным представляется исследование способов рассеивания информации, чтобы сделать её менее привлекательной для злоумышленников. В конце концов, самая надёжная защита — это отсутствие ценности для атакующего.

Оригинал статьи: https://arxiv.org/pdf/2511.21181.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Стоит ли покупать фунты за йены сейчас или подождать?

- Координация Роя: Новый Алгоритм для Планирования Задач и Движений

- Т-Технологии акции прогноз. Цена T

- ВСМПО-АВИСМА акции прогноз. Цена VSMO

- Сегежа акции прогноз. Цена SGZH

- Россети Центр и Приволжье акции прогноз. Цена MRKP

- AI, Приватность и Bitcoin: Ключевые Тренды Крипто-Рынка в 2026 Году (06.05.2026 12:15)

- Стоит ли покупать евро за малайзийские ринггиты сейчас или подождать?

- Amazon: Между Надеждой и Разочарованием

- Sotera Health: Что-то там продали… и что с того?

2025-11-30 01:41