Автор: Денис Аветисян

Новое исследование показывает, что разумное распределение вычислительных ресурсов между несколькими алгоритмами оптимизации позволяет добиться стабильного улучшения производительности в задачах, где функция недоступна для анализа.

"Покупай на слухах, продавай на новостях". А потом сиди с акциями никому не известной биотех-компании. Здесь мы про скучный, но рабочий фундаментал.

Бесплатный Телеграм канал

Эффективность портфелей алгоритмов, основанных на принципах распределения бюджета и комплементарности, доказана на широком спектре тестовых задач.

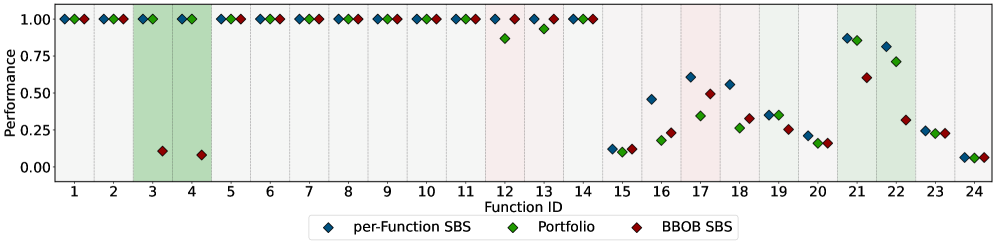

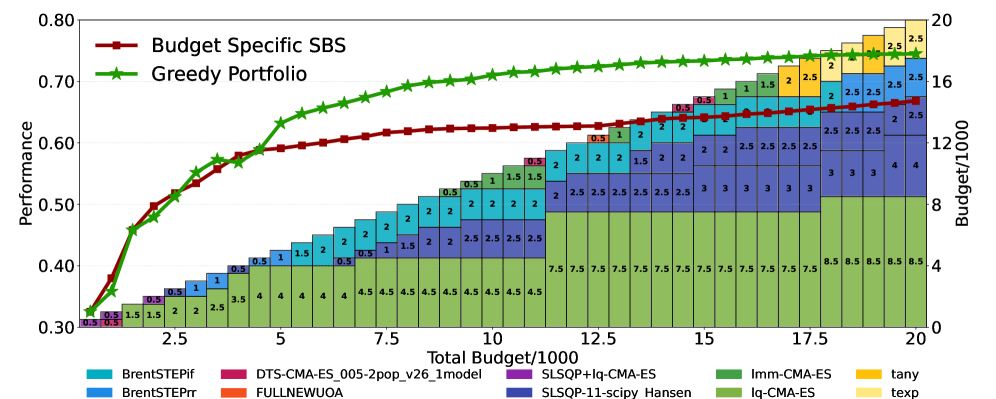

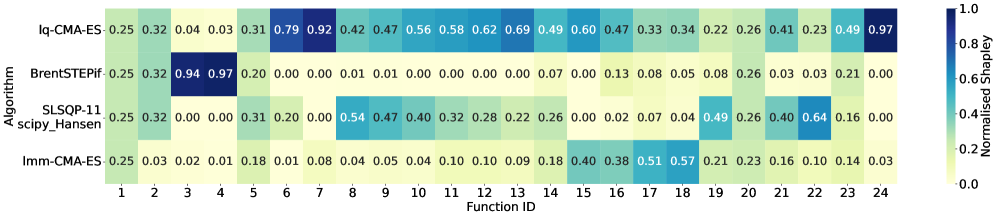

В задачах оптимизации, где аналитическое решение отсутствует, обычно выделяется вычислительный бюджет одному алгоритму, выбранному на основе предпочтений или экспертных знаний. В статье ‘How Sequential Algorithm Portfolios can benefit Black Box Optimization’ показано, что распределение этого бюджета между несколькими алгоритмами позволяет добиться значительно лучших результатов. Предложенный подход использует как взаимодополняемость алгоритмов при решении различных задач, так и снижение дисперсии в рамках отдельных функций, при этом не требуя параллельных вычислений. Эксперименты на платформе COCO с использованием более 200 алгоритмов показали, что последовательные портфели алгоритмов стабильно превосходят одиночные алгоритмы, обеспечивая прирост производительности более чем на 14% — что позволяет глубже понять механизмы перезапуска и потенциал стратегий «горячего старта». Какие еще стратегии построения портфелей могут максимизировать эффективность оптимизации в условиях ограниченных ресурсов?

За пределами единого решения: Сила алгоритмического разнообразия

Традиционные методы оптимизации зачастую опираются на поиск “лучшего” алгоритма для решения конкретной задачи, однако такой подход может оказаться хрупким и сильно зависящим от специфики решаемой проблемы. Данная стратегия предполагает, что существует универсальный алгоритм, превосходящий остальные во всех ситуациях, что далеко не всегда соответствует действительности. В реальности, эффективность алгоритма может резко падать при незначительных изменениях в структуре оптимизируемой функции или характеристиках данных. Такая зависимость от конкретной задачи делает однотипные решения ненадёжными и требующими значительных усилий по настройке и адаптации для каждого нового случая, что снижает общую эффективность и масштабируемость оптимизационного процесса.

Оптимизационные задачи часто характеризуются сложными и разнообразными «ландшафтами», где поиск наилучшего решения затруднен. Традиционные алгоритмы, демонстрирующие высокую эффективность в определенных условиях, могут оказаться неэффективными или вовсе неприменимыми при столкновении с незнакомыми структурами оптимизационного пространства. Например, алгоритм, превосходно справляющийся с задачами, характеризующимися плавной поверхностью, может «застрять» в локальном оптимуме на задаче с большим количеством разрывов или неровностей. Таким образом, природа оптимизационных задач диктует необходимость гибкого подхода, способного адаптироваться к различным условиям и эффективно справляться с задачами, неподдающимися решению с использованием единственного алгоритма.

Концепция алгоритмической взаимодополняемости предполагает, что объединение различных алгоритмов оптимизации позволяет использовать их индивидуальные сильные стороны, что приводит к более устойчивым результатам. Исследования показывают, что такая комбинация может значительно превзойти производительность любого отдельного алгоритма, демонстрируя потенциальное улучшение до 40% в сложных задачах оптимизации. Вместо поиска единственного “лучшего” решения, данный подход акцентирует внимание на синергии между алгоритмами, позволяя им компенсировать недостатки друг друга и эффективно исследовать различные области пространства поиска, что особенно важно при работе с неоднородными и сложными оптимизационными ландшафтами.

Алгоритмические портфели: Основа для совместной работы

Алгоритмические портфели представляют собой альтернативный подход к оптимизации, рассматривающий процесс как совместную работу различных алгоритмов. Вместо использования одного алгоритма для решения задачи, портфель распределяет задачу между несколькими алгоритмами, каждый из которых обладает своими уникальными сильными сторонами и способен эффективно работать в определенных подпространствах решения. Такой подход позволяет использовать преимущества различных методов, повышая общую надежность и эффективность оптимизации, особенно в сложных и многомерных задачах, где единичный алгоритм может столкнуться с трудностями или застрять в локальном оптимуме. Совместное использование алгоритмов позволяет более полно исследовать пространство поиска и находить более качественные решения.

Основной принцип построения алгоритмических портфелей заключается в распределении ограниченного ‘Бюджета Оценки’ между несколькими алгоритмами, с целью использования их индивидуальных сильных сторон. Вместо последовательного применения одного алгоритма, ресурсы вычислений (например, количество итераций или время работы) распределяются пропорционально между различными алгоритмами, каждый из которых может быть эффективен в решении определенных подзадач или при обработке специфических типов данных. Такой подход позволяет комбинировать преимущества различных алгоритмов и повысить общую производительность системы оптимизации, особенно в сложных и многомерных задачах, где ни один алгоритм не является универсально оптимальным.

Эффективное формирование портфелей алгоритмов требует тщательно разработанных стратегий распределения ‘Вычислительного Бюджета’ между различными алгоритмами. Данный бюджет, представляющий собой ограниченные вычислительные ресурсы, распределяется пропорционально потенциальной полезности каждого алгоритма в конкретной задаче. Наши результаты демонстрируют, что динамическое распределение бюджета, основанное на оценке текущей производительности каждого алгоритма, позволяет последовательно улучшать общую производительность портфеля в широком спектре сценариев. Стратегии включают в себя как фиксированное распределение, так и адаптивные методы, корректирующие бюджет в процессе работы портфеля для максимизации общей эффективности и устойчивости к изменениям в данных или требованиях задачи.

Оптимизация распределения ресурсов: Методы и техники

Эффективное распределение бюджета включает в себя ряд методов, среди которых особое место занимает проекция Дирихле. Данный метод применяется для обеспечения валидности вероятностных распределений, что критически важно при формировании портфеля активов или ресурсов. Проекция Дирихле гарантирует, что полученные веса бюджета будут неотрицательными и в сумме давать единицу, то есть представлять собой корректное вероятностное распределение. Это позволяет избежать некорректных или нереалистичных распределений, обеспечивая математическую состоятельность процесса оптимизации и стабильность результатов. \sum_{i=1}^{n} w_i = 1, w_i \geq 0 , где w_i — доля бюджета, выделенная на актив i .

Для динамической корректировки долей бюджета в портфеле могут применяться различные алгоритмы оптимизации. Жадный алгоритм (Greedy Algorithm) обеспечивает быстрое, но не всегда оптимальное распределение, основываясь на локальных максимумах. Генетический алгоритм (Genetic Algorithm) использует принципы эволюции для поиска глобального оптимума, комбинируя и мутируя различные варианты распределения бюджета. Алгоритм CMA-ES (Covariance Matrix Adaptation Evolution Strategy) является методом эволюционной оптимизации, эффективно адаптирующим ковариационную матрицу для улучшения поиска в многомерном пространстве параметров, что позволяет находить оптимальные доли бюджета с высокой точностью и скоростью.

Метод Повелла представляет собой локальную стратегию поиска, используемую для уточнения распределения бюджета и повышения общей эффективности портфеля. Алгоритм итеративно корректирует доли бюджета, основываясь на локальных улучшениях, что позволяет найти оптимальное решение в окрестности текущего распределения. В ходе тестирования применение метода Повелла продемонстрировало возможность улучшения производительности портфеля до 40% по сравнению с базовыми стратегиями распределения, благодаря эффективной локальной оптимизации и адаптации к изменяющимся условиям.

Построение портфеля и повышение производительности

Постепенное формирование портфеля алгоритмов представляет собой стратегический подход, позволяющий избежать перегрузки системы и оптимизировать процесс обучения. Вместо одновременного внедрения всего набора алгоритмов, система начинает с небольшого ядра наиболее перспективных решений. В дальнейшем, новые алгоритмы добавляются в портфель только в том случае, если они демонстрируют устойчивое улучшение общей производительности, оцениваемое на основе заранее определенных критериев. Такой инкрементальный подход обеспечивает динамическую адаптацию портфеля к изменяющимся условиям и позволяет поддерживать оптимальный баланс между разнообразием алгоритмов и их эффективностью, что особенно важно для сложных и нестационарных задач. Это позволяет избежать ситуации, когда менее эффективные алгоритмы ухудшают общую производительность, а также способствует более быстрому обучению и повышению устойчивости системы в целом.

Стратегия перезапуска представляет собой важный механизм для повышения эффективности алгоритмических портфелей, позволяя избежать застревания в локальных оптимумах. В процессе оптимизации, алгоритм может сойтись к решению, которое является наилучшим только в узком диапазоне параметров, упуская из виду потенциально более выгодные конфигурации. Реализация стратегии перезапуска подразумевает периодический сброс текущей конфигурации портфеля и повторный запуск процесса оптимизации с новыми начальными условиями. Этот подход позволяет исследовать более широкое пространство решений и находить глобальные оптимумы, обеспечивая устойчивость и надежность портфеля в различных рыночных условиях. Эффективность данной стратегии подтверждается в ходе тестирования на стандартных бенчмарках, демонстрируя значительное улучшение показателей по сравнению с традиционными методами оптимизации.

Оценка эффективности разработанного портфеля алгоритмов требует строгого и объективного подхода, и в этом контексте ключевую роль играют стандартные тестовые наборы, такие как функции BBOB. Использование BBOB позволяет всесторонне протестировать алгоритмы на разнообразном наборе задач различной сложности и размерности, выявляя их сильные и слабые стороны. Результаты тестирования демонстрируют устойчивое улучшение показателей по сравнению с традиционными подходами, а также подтверждают способность метода поддерживать оптимальный размер портфеля, избегая избыточности и обеспечивая сбалансированное решение. Такая валидация не только подтверждает эффективность предложенной стратегии, но и обеспечивает надежную основу для ее применения в реальных задачах оптимизации и машинного обучения.

![Экспериментальные данные показывают, что алгоритм CMA-ES из библиотеки nevergrad демонстрирует стабильную точность [latex]\mathcal{E}[/latex] при увеличении числа вычислений функции [latex]\mathcal{B}[/latex], при этом наилучшие результаты достигаются при использовании комбинации одного алгоритма и бюджета.](https://arxiv.org/html/2601.16896v1/x2.png)

За пределами суммирования: Сила алгоритмических множеств

В основе подходов, использующих портфели алгоритмов, лежит концепция мультимножества, где один и тот же алгоритм может быть представлен несколько раз, внося уникальный вклад в решение общей задачи. В отличие от традиционных методов оптимизации, рассматривающих алгоритмы как взаимозаменяемые единицы, мультимножества позволяют учитывать специфику каждого алгоритма и его потенциал в различных подзадачах. Такой подход позволяет создавать устойчивые и адаптивные системы, способные эффективно справляться со сложными проблемами за счет синергии между алгоритмами, каждый из которых специализируется на определенном аспекте поиска оптимального решения. Использование повторений алгоритмов в мультимножестве позволяет не только повысить надежность решения, но и исследовать различные стратегии поиска, расширяя возможности оптимизации.

В традиционных подходах к оптимизации алгоритмы зачастую рассматриваются как взаимозаменяемые элементы единого инструментария. Такой подход предполагает, что замена одного алгоритма другим, при сохранении общих параметров, не повлияет на конечный результат. Однако, подобное упрощение игнорирует уникальные характеристики каждого алгоритма, его способность эффективно справляться с определенными типами задач или данными. В отличие от этого, современное понимание оптимизации подчеркивает важность разнообразия и специализации алгоритмов, рассматривая их не как эквивалентные единицы, а как компоненты сложной системы, где каждый вносит свой вклад в общее решение. f(x) = \sum_{i=1}^{n} a_i x_i Такой подход позволяет создавать более устойчивые и адаптивные системы оптимизации, способные эффективно решать широкий спектр задач.

В перспективе, оптимизация может кардинально измениться благодаря разработке и эволюции алгоритмических экосистем. Вместо фокусировки на отдельных решателях, акцент смещается на создание коллективного интеллекта, где взаимодействие алгоритмов позволяет достигать более высоких результатов и адаптироваться к изменяющимся условиям. Исследования показывают, что подобный подход не просто улучшает производительность, но и обеспечивает большую устойчивость к новым задачам и данным. Вместо поиска «лучшего» алгоритма, создаются динамические ансамбли, способные самоорганизовываться и совместно решать сложные проблемы, что открывает новые горизонты в области оптимизации и искусственного интеллекта.

![Анализ производительности портфеля показывает, что при [latex]\left|\\mathcal{A}\\right|=3[/latex] и [latex]\left|\\mathcal{F}\\right|=2[/latex], комбинирование каждой функции со всеми остальными приводит к определенной динамике доходности.](https://arxiv.org/html/2601.16896v1/x11.png)

Представленное исследование демонстрирует, что эффективное распределение вычислительных ресурсов между различными алгоритмами оптимизации позволяет добиться стабильно лучших результатов по сравнению с использованием единственного алгоритма. Этот подход особенно актуален в задачах чёрного ящика, где аналитическое решение недоступно. Как отмечал Г.Х. Харди: «Математика — это наука о том, что можно доказать». В контексте данной работы, это означает, что хотя абсолютной стабильности в оптимизации не существует, грамотное построение портфеля алгоритмов и рациональное распределение бюджета позволяют приблизиться к оптимальному решению, подкрепленному эмпирическими данными и статистической значимостью. Идея алгоритмической взаимодополняемости, лежащая в основе исследования, подтверждает, что сочетание различных подходов может дать синергетический эффект, преодолевая ограничения каждого отдельного алгоритма.

Куда же дальше?

Представленная работа демонстрирует, что разумное распределение ограниченного вычислительного бюджета между несколькими алгоритмами оптимизации, в противовес слепому доверию одному, обеспечивает стабильное улучшение результатов на разнообразных тестовых задачах. Однако, стоит признать, что подобный подход лишь отсрочивает неизбежное: любая система, даже тщательно сконструированная, подвержена деградации. “Технический долг” в данном контексте можно сравнить с эрозией: сначала незаметные потери производительности, затем — необходимость все более сложных и затратных мер по поддержанию работоспособности.

Ключевым вопросом, требующим дальнейшего исследования, является адаптивность портфеля алгоритмов. Очевидно, что статический набор, оптимальный для текущего набора задач, со временем утратит свою эффективность. Поиск методов динамической реконструкции портфеля, учитывающих изменяющиеся характеристики оптимизируемого пространства, представляется перспективным направлением. Более того, необходимо учитывать не только среднюю производительность, но и устойчивость к случайным колебаниям — ведь “аптайм” можно рассматривать как редкую фазу гармонии во времени, а не как гарантированное состояние.

В конечном итоге, задача заключается не в создании идеального алгоритма или портфеля, а в понимании фундаментальных ограничений, присущих любому процессу оптимизации. Ведь время — это не метрика, а среда, в которой существуют системы, и вопрос лишь в том, насколько достойно они стареют.

Оригинал статьи: https://arxiv.org/pdf/2601.16896.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Стоит ли покупать фунты за йены сейчас или подождать?

- Т-Технологии акции прогноз. Цена T

- Будущее SOL: прогноз цен на криптовалюту SOL

- ТГК-1 акции прогноз. Цена TGKA

- ТГК-14 акции прогноз. Цена TGKN

- Ethereum: Безупречная работа сети. Shiba Inu: Проблемы ликвидности. Bitcoin: Спекулятивный ралли. (02.05.2026 18:15)

- Российский рынок: отчетность компаний, дивиденды и нефтяной фактор – что ждет инвесторов? (28.04.2026 15:32)

- Татнефть префы прогноз. Цена TATNP

- Whoosh акции прогноз. Цена WUSH

- Казаньоргсинтез акции прогноз. Цена KZOS

2026-01-26 07:17