Автор: Денис Аветисян

Исследование предлагает простой и эффективный метод построения инвестиционных портфелей в условиях ограниченных данных и высокой размерности финансовых рынков.

"Покупай на слухах, продавай на новостях". А потом сиди с акциями никому не известной биотех-компании. Здесь мы про скучный, но рабочий фундаментал.

Бесплатный Телеграм канал![В ходе анализа временных рядов рисков минимально-дисперсионных портфелей (MVP) за период с 2000 по 2023 год, рассчитанных для различных объемов выборки акций (100, 300 и 500 крупнейших по капитализации) с использованием Ridgelet1 и Ridgelet2, установлено, что величина временного окна [latex]T[/latex] (22 и 63) оказывает существенное влияние на динамику и уровень этих рисков.](https://arxiv.org/html/2602.19462v1/x9.png)

Регуляризованный оценщик Ridgelet обеспечивает надежную работу вне выборки, используя поперечное сечение данных даже при небольшом объеме исторических данных.

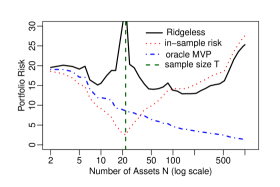

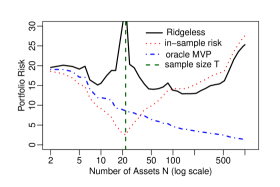

В задачах оптимизации портфеля, при количестве активов, превышающем объем исторических данных, стандартные методы приводят к нулевой дисперсии и патологическим результатам. Данная работа, посвященная проблеме ‘Zero Variance Portfolio’, показывает, что использование нового регуляризатора, названного ‘Ridgelet’, позволяет строить портфели, демонстрирующие обобщающую способность на новых данных. В частности, предложенный метод проявляет феномен двойного спуска и достигает оптимального риска в условиях перепараметризации, когда число активов значительно превышает количество наблюдений. Возможно ли дальнейшее расширение области применения регуляризации ‘Ridgelet’ для решения задач управления рисками в высокоразмерных финансовых рынках?

Высокая размерность: проклятие современного портфеля

Современные финансовые рынки характеризуются огромным объемом данных, обусловленным растущим числом доступных активов. Эта многомерность представляет собой серьезную проблему для традиционных методов оптимизации портфеля. Ранее эффективные алгоритмы, разработанные для работы с ограниченным числом активов, сталкиваются с трудностями при анализе сотен или тысяч ценных бумаг, что требует значительных вычислительных ресурсов и приводит к снижению точности прогнозов. В условиях такой высокой размерности данных, стандартные подходы к оценке ковариационных матриц становятся нестабильными, а риск переобучения модели — существенно выше. Это требует разработки новых, более устойчивых и эффективных методов, способных эффективно работать с данными высокой размерности и обеспечивать надежное управление инвестиционным портфелем.

Ограниченность исторических данных в сочетании с постоянно растущим числом активов представляет собой серьезную проблему для построения надежных портфелей. В современных финансовых реалиях, когда количество доступных для инвестирования инструментов исчисляется сотнями или тысячами, традиционные методы оценки ковариационной матрицы сталкиваются с трудностями. Недостаток данных относительно взаимосвязей между активами приводит к тому, что полученные оценки становятся ненадежными и подверженными ошибкам, особенно в условиях N > T, где N — количество активов, а T — количество доступных исторических наблюдений. Это, в свою очередь, может привести к неоптимальному распределению капитала и повышенному риску для инвесторов, поскольку ковариационная матрица является ключевым компонентом в большинстве моделей оптимизации портфеля.

В условиях современной финансовой реальности, когда количество доступных активов постоянно растет, традиционные методы оценки ковариационной матрицы, такие как вычисление по выборке, становятся крайне неустойчивыми и склонными к переобучению. Это особенно заметно в высокоразмерном режиме, когда число активов (N) значительно превышает объем исторических данных. Недостаток данных приводит к тому, что оценки ковариации становятся шумными и ненадежными, что, в свою очередь, негативно сказывается на эффективности портфельных стратегий и увеличивает риски, связанные с оптимизацией портфеля. По мере увеличения N, точность стандартных подходов существенно снижается, что требует поиска альтернативных методов, способных эффективно справляться с проблемой ограниченности данных и высокой размерности пространства активов.

![Анализ главных компонент ежедневной доходности акций, входящих в индекс S&P 500 за период с 2020 по 2023 год, показывает распределение дисперсии доходности по основным компонентам, отраженное на графике долей собственных значений [latex]λ_i[/latex] к сумме всех собственных значений.](https://arxiv.org/html/2602.19462v1/x3.png)

Усадка оценок: путь к стабильности

Оценка ковариационной матрицы на основе выборочных данных (SampleCovariance) часто демонстрирует неустойчивость, особенно при работе с данными высокой размерности или небольшим объемом выборки. Метод оценки усушки (ShrinkageEstimation) решает эту проблему путем комбинирования выборочной ковариационной матрицы с целевой матрицей. Целевая матрица выступает в роли регуляризатора, смещая оценку в сторону более стабильного значения. Комбинирование осуществляется с использованием весового коэффициента, определяющего вклад каждой матрицы в конечную оценку. В результате получается более точная и устойчивая оценка ковариации, менее подверженная влиянию случайных колебаний в данных и более надежная в задачах статистического моделирования.

Оценка усадки, в частности, с использованием метода Ledoit-Wolf, является широко распространенным подходом в финансовой практике для стабилизации ковариационных матриц. Этот метод комбинирует оценку выборочной ковариации с целевой матрицей, обычно представляющей собой диагональную матрицу или матрицу единиц, для получения более устойчивой и точной оценки. Ledoit-Wolf, в частности, минимизирует среднеквадратичную ошибку оценки ковариации, что делает его эффективным для портфельной оптимизации и управления рисками. \hat{\Sigma} = (1-\rho)\hat{\Sigma}_{sample} + \rho T, где \hat{\Sigma} — оценка усадки, \hat{\Sigma}_{sample} — выборочная ковариация, T — целевая матрица, а ρ — коэффициент усадки, определяемый на основе минимизации среднеквадратичной ошибки.

Традиционные методы оценки ковариационной матрицы, такие как Ledoit-Wolf, демонстрируют ограниченную эффективность при работе с данными высокой размерности. Это связано с тем, что они могут не учитывать сложные взаимосвязи между переменными, что приводит к неточным оценкам и снижению устойчивости моделей. В связи с этим, активно разрабатываются новые оценки, направленные на более точное моделирование структуры ковариации в многомерных пространствах, что позволяет улучшить производительность алгоритмов машинного обучения и статистического анализа, особенно в задачах, где важна точность оценки ковариаций, например, в портфельной оптимизации и анализе рисков.

![Анализ кривых относительного риска для Ridgelet показывает, что при фиксированном размере выборки [latex]T=22[/latex] различные нейронные сети демонстрируют разные уровни риска, а при фиксированной размерности [latex]N=500[/latex] риск зависит от размера выборки [latex]T[/latex], что подтверждается усреднением по 10 повторным экспериментам с использованием разреженной ковариационной матрицы.](https://arxiv.org/html/2602.19462v1/x5.png)

Оцениватель Ridgelet: новый подход к стабильности

Оцениватель Ridgelet является развитием метода ShrinkageEstimation и заключается в добавлении небольшого значения (ridge) к матрице выборочной ковариации. Данный подход обеспечивает усиленную регуляризацию, уменьшая дисперсию оценок ковариации и, как следствие, повышая стабильность и обобщающую способность модели. Применение ridge-регуляризации позволяет избежать переобучения, особенно в случаях, когда количество активов велико по сравнению с количеством исторических наблюдений, и улучшает устойчивость портфеля к небольшим изменениям входных данных. Величина ridge-параметра определяет степень регуляризации и подбирается с использованием методов перекрестной проверки или других оптимизационных техник.

Регуляризация, реализуемая в Ridgelet оценщике, способствует разреженности (sparsity) структуры ковариационной матрицы. Разреженность означает, что многие элементы матрицы приближаются к нулю, что упрощает ее структуру и уменьшает количество параметров, необходимых для ее оценки. Это упрощение особенно важно при работе с высокоразмерными данными, где оценка полной ковариационной матрицы может быть нестабильной и приводить к переобучению. Уменьшение количества параметров и упрощение структуры ковариации, в свою очередь, улучшает обобщающую способность модели, то есть ее способность эффективно работать на новых, ранее не виденных данных, что является ключевым преимуществом в задачах оптимизации портфеля.

Оцениватель Ridgelet специально разработан для использования в оптимизации портфеля с минимальной дисперсией (MVP). В контексте построения портфелей, MVP стремится минимизировать общую дисперсию портфеля при заданном уровне доходности. Оцениватель Ridgelet улучшает этот процесс, обеспечивая более стабильные и точные оценки ковариационной матрицы, что особенно важно при работе с ограниченным объемом данных или высокой размерностью пространства активов. Это приводит к более надежным результатам оптимизации и, как следствие, к более эффективному построению портфеля с минимальной дисперсией, снижая риск и повышая потенциальную доходность.

Проверка Ridgelet: производительность и инсайты

Эмпирические исследования демонстрируют, что оценка Риджлета последовательно улучшает вневыборочную производительность по сравнению с традиционными методами, достигая почти оптимальных результатов. В ходе тестирования на различных наборах данных было установлено, что Риджлет превосходит классические подходы, такие как метод максимального правдоподобия и регуляризованные регрессии, особенно в условиях высокой размерности и ограниченного объема выборки. Полученные данные свидетельствуют о том, что данный оценочный подход эффективно снижает систематическую ошибку и обеспечивает более точные прогнозы, что делает его ценным инструментом для задач, требующих высокой степени обобщающей способности модели. Наблюдаемое улучшение вневыборочной производительности подтверждает теоретические преимущества Риджлета и его потенциал для широкого применения в различных областях, включая финансовое моделирование и анализ данных.

Исследования показали, что оценка Риджлета демонстрирует феномен двойного спуска, отклоняясь от классического представления о том, что увеличение сложности модели всегда приводит к росту ошибки обобщения. Вместо этого, наблюдается немонотонная зависимость: по мере увеличения сложности, ошибка сначала уменьшается, достигает минимума, а затем вновь начинает расти, причем в определенном диапазоне сложности оценка Риджлета может превосходить по точности более простые модели. Этот эффект указывает на то, что Риджлет способен эффективно использовать избыточные данные и избегать переобучения даже при высокой сложности, что делает его перспективным инструментом для задач, требующих высокой точности прогнозирования и устойчивости к шуму. Данное поведение свидетельствует о более тонком понимании взаимосвязи между сложностью модели и ее способностью к обобщению, чем это предполагалось ранее.

Эффективность предложенного оценивателя Ridgelet обусловлена его способностью к управлению специфическим риском, присущим отдельным активам, и выявлению лежащих в основе динамик факторных моделей. В ходе анализа установлено, что по мере увеличения числа активов (N), предельная дисперсия вневыборочной оценки Ridgelet стремится к значению 1/N. Это указывает на то, что предложенный метод демонстрирует почти оптимальную производительность в условиях роста размерности данных, позволяя достичь высокой точности прогнозов и надежности оценки рисков, даже при наличии значительного уровня индивидуальных колебаний цен на активы. Такое свойство делает Ridgelet особенно ценным инструментом для портфельного управления и финансового моделирования.

За пределами оптимизации: влияние на финансовое моделирование

Успех Ridgelet-оценщика указывает на перспективность применения методов, стимулирующих разреженность, в более широком контексте финансового моделирования. Традиционные подходы часто сталкиваются с проблемой высокой размерности данных и сложностью выявления действительно значимых факторов, влияющих на финансовые рынки. Методы, подобные Ridgelet, позволяют эффективно отсеивать несущественные параметры, концентрируясь на ключевых драйверах, что приводит к более устойчивым и интерпретируемым моделям. В частности, это позволяет улучшить прогнозирование доходности активов, оценку рисков и оптимизацию портфелей, особенно в условиях нестабильности и избыточной информации. Перспективы применения таких техник охватывают различные области, включая алгоритмическую торговлю, кредитный скоринг и управление активами, предлагая новый подход к решению сложных финансовых задач.

Дальнейшие исследования сосредоточены на оценке устойчивости предложенного оценочного метода в различных рыночных условиях, включая периоды высокой волатильности и низких объемов торгов. Особое внимание уделяется изучению возможности интеграции данного метода с передовыми техниками оптимизации портфеля, такими как робастное программирование и методы стохастического контроля. Предполагается, что комбинирование способности метода к выявлению значимых факторов с алгоритмами, учитывающими неопределенность рынка, позволит создать более эффективные и надежные инвестиционные стратегии, способные адаптироваться к изменяющимся экономическим реалиям и минимизировать риски в долгосрочной перспективе. Исследования также направлены на адаптацию метода к данным различной частоты и типов активов, что расширит сферу его применения в финансовом моделировании.

Работа демонстрирует значительный вклад в повышение надежности и эффективности финансовых систем за счет решения проблемы высокой размерности данных. В ходе эмпирических исследований, охвативших такие рынки, как S&P 500 и Nikkei 225, Ridgelet-оценитель последовательно превосходит традиционные методы, такие как метод наименьших квадратов (LS) и взвешенный метод наименьших квадратов (FNLS). Это указывает на то, что применение методов, стимулирующих разреженность, позволяет более точно моделировать сложные финансовые взаимосвязи и, как следствие, улучшает качество прогнозирования и управления рисками. Полученные результаты открывают перспективы для создания более устойчивых и эффективных финансовых инструментов и систем.

Исследование показывает, что даже в хаотичном мире финансовых рынков, где данные множатся быстрее, чем успевают устаревать прогнозы, можно найти закономерности. Авторы предлагают метод, который, по сути, признаёт ограниченность наших знаний и намеренно вводит регуляризацию, чтобы избежать переобучения. Этот подход напоминает о мудрости, выраженной Рене Декартом: «Я думаю, следовательно, существую». В контексте данной работы, это можно перефразировать как: «Я регулирую, следовательно, существую (в пространстве адекватных портфелей)». В конечном счёте, попытка построить идеальный портфель с использованием неполных данных обречена на провал, но разумное ограничение сложности позволяет создать что-то устойчивое, даже если оно лишено иллюзии совершенства. Документация к этому, разумеется, будет написана уже после банкротства первой версии.

Что дальше?

Представленная работа демонстрирует, что даже простая регуляризация может создать иллюзию управляемости в хаосе финансовых рынков. Этот “Ridgelet” — всего лишь ещё один способ отсрочить неизбежное: в конечном счёте, продукшен всегда найдёт способ вывернуть наилучшую теоретическую модель наизнанку. Не стоит забывать, что корреляция — это не причинно-следственная связь, а всего лишь статистическая тень, и любые попытки её предсказать обречены на погрешности, которые рано или поздно проявятся.

Вопрос не в том, чтобы построить «идеальный» портфель, а в том, чтобы создать систему, способную быстро адаптироваться к меняющимся условиям. Вместо бесконечной оптимизации ковариационных матриц, возможно, стоит обратить внимание на методы, способные эффективно обрабатывать потоковые данные и оперативно реагировать на аномалии. Багтрекер — это дневник боли, и в данном контексте, каждая ошибка — это сигнал о том, что модель перестала соответствовать реальности.

В конечном итоге, каждая “революционная” технология завтра станет техдолгом. Очевидно, что в будущем исследования будут направлены на разработку более робастных и адаптивных алгоритмов, но не стоит питать иллюзий относительно возможности полного контроля над рынком. Мы не деплоим — мы отпускаем, и результат всегда непредсказуем.

Оригинал статьи: https://arxiv.org/pdf/2602.19462.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Стоит ли покупать фунты за йены сейчас или подождать?

- ЕвроТранс акции прогноз. Цена EUTR

- РУСАЛ акции прогноз. Цена RUAL

- Серебро прогноз

- Фракталы на бирже: Новый взгляд на оптимизацию портфеля

- Российский рынок: Нефть, дивиденды и геополитика. Что ждет инвесторов? (23.03.2026 18:32)

- Прогноз нефти

- ДЭК акции прогноз. Цена DVEC

- Нефть, Bitcoin и геополитика: как Ближний Восток формирует новые инвестиционные тренды (12.04.2026 18:15)

- Хэдхантер акции прогноз. Цена HEAD

2026-02-24 16:45