Адаптивное внимание: как ускорить большие языковые модели без потери качества

![Исследование динамики обучения механизма Elastic Attention выявило, что разделение общей функции потерь на основную языковую модель и регуляризацию разреженности позволяет модели автоматически различать задачи, устойчивые к разреженности (с использованием [latex]\Omega\_{\mathrm{MSR}}[/latex]) и чувствительные к ней, посредством адаптации коэффициентов λ, что демонстрирует принципиально новый подход к оптимизации разреженности в нейронных сетях.](https://arxiv.org/html/2601.17367v1/x23.png)

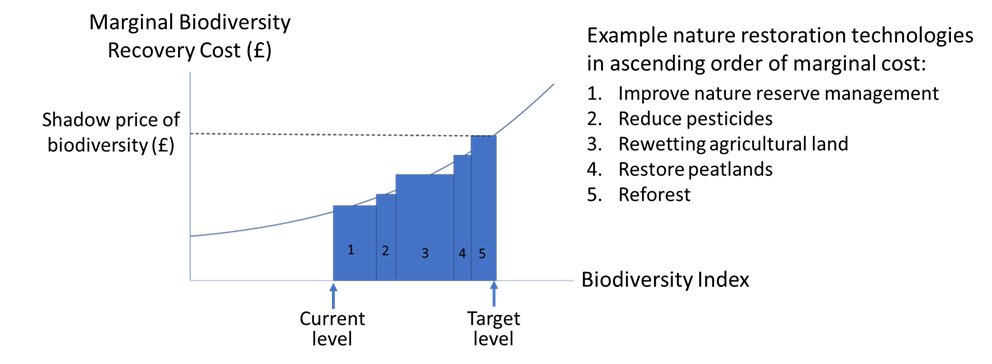

Новый подход к разреженному вниманию позволяет динамически регулировать вычислительные затраты больших языковых моделей во время работы, оптимизируя их производительность для различных задач.

![Система функционирует, принимая решения о выборе между получением новых обновлений ([latex]s[/latex]) или отказом от текущих и запросом новых ([latex]pp[/latex]).](https://arxiv.org/html/2601.16624v1/x1.png)